Курсовая работа: Проблеми штучного інтелекту

2. інформаційна закритість

3. обов'язковість

4. висока швидкість

5. поверхнева обробка

6. біологічне походження

7. селективність випадінь

8. фіксованості нейроанатоміческіх механізмів.

Нейронна метафора

Якщо на початку виникнення когнітивного підходу багато психологів сприйняли спочатку як звільнення від необхідності цікавитися мозковим субстратом та можливими нейрофізіологічним механізмами тих чи інших пізнавальних процесів, то протягом останнього десятиліття 20-го століття яскраво продивляється глобальна тенденція, що пов'язана із зростанням інтересу до мозкових механізмів - реальної архітектурі пізнавальних процесів.

У подальші роки з появою безлічі нестандартних архітектур в коннекціонізмі і, особливо, у зв'язку із спекуляціями про мозкову локалізацію тих чи інших «когнітивних модулів» природно стало виникати питання про те, як ці гіпотетичні механізми реалізовані насправді. Змінився і сам характер когнітивних досліджень, які в значній мірі спираються сьогодні на дані нейропсихологічних і нейрофізіологічних робіт. Починаючи з 1990-х років послабився вплив власне комп'ютерної метафори і машинних моделей.

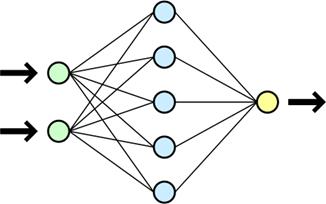

Отже, іншим впливовим підходом впродовж останніх 20 років став так званий PDP-підхід (від paralle ldistributed processing = паралельно розподілена обробка), широко відомий також як коннекціонізм. В даному випадку також іде мова про відмову від комп’ютерної метафори в її символьному варіанті. Однак, якщо концепція когнітивних модулів Федора лише допускає деяку паралельність обробки в яких-небудь частинах когнітивної моделі, то в коннекціонізмі паралельність опрацювання стає загальним принципом. Мова іде про те, що всі елементи системи, що інтерпретується як нейронна мережа, розглядаються як такі, що потенціально пов’язані між собою і одночасно беруть участь у формуванні відповіді на стимул.

Схема найпростішої мережі.

Головна перевага нейронних моделей у порівнянні традиційними когнітивними моделями полягає можливості асоціативного і розподіленого збереження інформації а також адаптивного навчання. Перша особливість означає, що будь-який фрагмент першопочаткової ситуації чи будь-яка початкова обставина здатні асоціативно підтримати пригадування. Розподіленим зберігання є тому, що його субстратом є у кожному окремому випадку не окремий елемент, а мережа в цілому, тобто стани всіх її вузлів і вагомість їх зв’язків. Нарешті, конекціонізм дозволяє природно описувати деякі елементарні форми навчання. Процеси навчання у нейронних мережах мають власну специфіку, найпростіша, суто асоціативна процедура навчання в нейронних мережах стосується класичних іде прокладення шляхів паловської фізіології.

Правило Хебба: між усіма синхронно активованими нейронами знижуються пороги синаптичних зв'язків (підвищуються вагові коефіцієнти активаційних зв'язків). В результаті багаторазових повторень поширення активації при виникненні на вході тієї ж ситуації відбувається швидше; група елементів, «ансамбль», активується як ціле, і ця активація відбувається навіть при змінах ситуації, наприклад, випаданні якихось компонентів зображення, а також «відмирання» частини «нейронів» самої мережі. Тим самим, вдається моделювати особливості цілісного сприйняття, описаного гештальтпсихології. Подібна терпимість до спотворень на вході і до порушень механізму обробки інформації разюче контрастує з тендітністю звичайних символьних програм. Крім того, пластичність синаптичних зв'язків, що лежить в основі формування ансамблів, дозволяє дати фізіологічне пояснення процесів узагальнення (категоризації) окремих ситуацій. Недоліком описаного механізму самоорганізації нейронних зв'язків є його надзвичайно повільний, що вимагає сотень і тисяч повторень, характер.

Прикладом більш ефективного комп'ютерного алгоритму навчання служить запропонований канадським інформатиком Джеффрі Хінтон і його колегами метод зворотного поширення помилки. У цьому випадку мережі пред'являється деяка конфігурація, а потім відповідь на виході порівнюється з ідеальною, бажаною відповіддю. Результат такого порівняння обчислюється і пропускається потім у зворотному напрямку: від виходу мережі до її вхідного шару, причому на кожному проміжному етапі здійснюються деякі корекції вагових коефіцієнтів зв'язків елементів з метою подальшої мінімізації неузгодженості. Але «контрольована мінімізація неузгодженості» залишає сильне враження довільного підбору бажаного результату.

Ряд коннекціоністскіх моделей використовує зворотні зв'язки для повторного пропускання продуктів обробки через нейронну мережу. Ця властивість, рекурентність, дозволяє обробляти конфігурації на вході в контексті попередніх подій («минулого досвіду»).

У настільки динамічній області, як когнітивна наука, важко прогнозувати майбутній розвиток подій. У рамках робіт з обчислювальною нейронаукою (нейроінтеллектом) і еволюційним моделюванням останнім часом починають розглядатися більш реалістичні, з біологічної і біофізичної точки зору, альтернативи штучним нейронним мережам. При збільшенні обсягу мозку в процесі еволюції вихідний мережевий принцип «все пов'язано з усім» перестає виконуватися, виникають елементи модулярної макроорганізаціі (Striedter, 2004).

У зв’язку з появою вової хвилі зацікавленості у процесах головного мозку і появою нових можливостей у технологічному плані, виникли нові методи дослідження головного мозку. Аж до самого останнього часу існували дві основні групи методів вивчення нейрофізіологічних механізмів:

Найбільш відомим з новітніх методів є позитронно-емісіонна томографія (ПЕТ). Негативним чинником є необхідність введення у кров радіоактивної речовини з нестійкими ізотопами. При активізації якої-небудь ділянки мозку, кров направляється туди, де і проходить розпад, продукти якого потім реєструються. Цей метод забезпечує високе просторове розширення але може реєструвати тільки зміни, що протікають досить повільно, не швидше хвилини.

У багатьох сенсах набагато більш ефективним методом є магніто резонансна томографія (МРТ). Цей метод дозволяє точну і доволі швидку регістра цію крім того, він не призводить до порушень організму, так як заснований на випромінені радіохвиль певної частоти окремими атомами, що знаходяться у змінному магнітному полі. В експериментальній психології цей метод використовується у вигляді функціональної МРТ, коли визначається концентрація кисню у крові. Цей показник пов”язаний з активністю нейронів у відповідних структурах мозку.

Недоліком фМРТ є низьке часове розширення (до 1 сек). Однак саме ця методика на сьогодні ший день є найточнішою.

Також існує безліч інших методів дослідження фізіологічного субстрату когнітивних функцій людини, також пов’язаних з проривом у технологічній сфері. В тому числі важливу роль зіграли розробки у мілітаристській сфері, що стали доступні для цивільного використання. Перша модель організації мозку запропонував Джон Х’юлінг-Джексон, невролог кінця 19 століття, що в своїй роботі спирався на еволюційну теорію Дарвіна. Одним з радянських вчених, що займався цією проблемою, був А. Р. Лурія. Він визначив трьохрівневу систему організації мозку. Подібні дослідження вирішують одну і ту саму задачу, стратифікацію. Тобто виділення в цілісному масиві окремих рівнів, що мають деякі спільні характеристики.

Частина 2. Порівняння штучного і природного інтелекту

Існує кілька основних питань штучного інтелекту. Наприклад про мозок. Якого роду мислячою машиною він є? Протягом століть психологічних досліджень, а особливо – кількох останніх десятиліть, відповідь на це питання починає роз’яснюватись. У потоці нових даних, поява яких завдячує використанню нових методів трьохвимірного вивчення мозку, стало непросто визначати аналоги традиційних психологічних понять і ранні когнітивні моделі, що будувалися на теренах комп’ютерної метафори. Стало остаточно зрозуміло, що, якщо мозок і можна порівняти з сучасною обчислювальною технікою, то слід пам’ятати про його відмінність. В прешу чергу відмінність полягає в існуванні еволюційного і онтогенетичного розвитку, а також у надзвичайно великій кількості елементів і зв’зків між ними. Можливо, дослідження штучного інтелекту просунулися б ще глибше, якби комп’ютер був більше скожий на мозок.

Ось порівняння мозку і комп’ютеру, що приводить Солсо.

| Кремнієві комп'ютери | Вуглеводневий мозок | |

| Швидкість обробки | Наносекунди | Від мілесекунд до секунд |

| Тип | Послідовний процесор | Параллельний процессор |

| Ємність пам'ті | Більша для оцифрованої інформації | Більша для зорової і мовної інформації |

| Матеріал | Кремній і систма електронного забезпечення | Нейрони і система органічного забезпечення |

| Взаємодія | Абсолютно керований | Має власну точку зору |

| Здатність до навчання | Керується правилами | Понятійний |

| Краща якість | Швидкість обробки інформації, керованість, передбвчуваність | Легко робить висновки, узагальнення, виносить судження. Мобільний. |

| Найгірша якість | Не може вчитися самостійно, погано виконує складні когнітивні функції, знижена мобільність. | Має обмежену здатність до обробки і збереженння інформації, здатен до забування. |

Для того, щоб поглибити досягнення у сфері штучного інтелекту слід спершу відповісти на питання як машина може імітувати мислення людини. Однією з найпоширеніших відповідей на цей час є така, що приймає точку зору коннекціонізму. Тобто сверджується, що найкращим способом є моделювання машин за принципом будови основних нервових структур.

Також, на основ відповіді на попереднє питання виникає нове, що постає основною проблемою на сучасному етапі розвитку наук, що займаються створенням штучного інтелекту. Якщо змоделювати штучну людину, при цьому врахувавши всі недоліки справжньої істоти, чи можливо, щоб комп’ютер перевершив живу істоту? Адже вже зараз деякі програми працюють ефективніше за людське мислення. Але більшість з них, на даний момент, лише грубі бідробки тонкого мисленнєвого апарату людського мислення. Комп'ютери можуть вирішувати деякі завдання, наприклад складні математичні, швидше і точніше, ніж люди, але завдання, що вимагають узагальнень та навчання новим патернам поведінки, люди вирішують краще комп'ютерів.

Для більш-менш об’єктивного порівняння можливостей мозку і комп’ютеру можна взяти показник потужності кожного. Спробуємо оцінити потужність людського мозку комп'ютерними мірками. Він складається з приблизно 100 млрд. нейронів. Кожен нейрон представляє собою мініатюрний «процесор» і пов'язаний з іншими нейронами 5 тисячами синапсів. У зв'язку з хімічною природою передачі інформації, затримка нейрона становить 0.01 сек., тобто робоча частота нейрона близько 100 Гц. Кожен сигнал синапсу можна оцінити приблизно в 5 біт. В результаті отримуємо потужність одного нейрона – 1000000 оп / с. Для всього мозку - 10 ^ 17 оп / с. На сьогоднішній день середній домашній комп'ютер володіє продуктивністю 10 ^ 9 оп / с, найпотужніші у світі комп'ютери - приблизно 10 ^ 13 оп / с, що поки в 10 тисяч разів менше потужності людського мозку.