Курсовая работа: Расчет параметров цифровых систем передачи непрерывных сообщений 2

Найдем требуемое значение отношения ![]()

![]() , обеспечивающее требуемое качество.

, обеспечивающее требуемое качество.

![]() (5.4)

(5.4)

![]() (5.5)

(5.5)

![]()

6 РАСЧЕТ ЭНТРОПИИ ИСТОЧНИКА СООБЩЕНИЙ

Энтропия источника сообщения – это его информационная характеристика.

Для расчёта энтропии целесообразнее всего воспользоваться приближённой формулой, которая является достаточно точной при большом числе уровней квантования:

(6.1)

(6.1)

где W(x) – плотность вероятности сообщения;

h – значение интервала квантования;

Um – порог ограничения сообщения.

(6.2)

(6.2)

Для четвертого распределения энтропия выражается следующей формулой:

H(x) =  (6.3)

(6.3)

H(x) = 13 - 0,5 +  =12,5 - 1 = 11,5 бит/симв

=12,5 - 1 = 11,5 бит/симв

7 РАСЧЕТ ИЗБЫТОЧНОСТИ И ИНФОРМАЦИОННОЙ НАСЫЩЕННОСТИ СООБЩЕНИЙ

Для оценки избыточности сначала рассчитаю информационную насыщенность сообщения:

Iн (x)=![]() (7.1)

(7.1)

где Hмакс – максимальная энтропия источника, достигаемая при равномерном распределении.

Тогда избыточность может быть найдена и выражена

R(x) = 1 – Iн (x) = 1 - 0,885 = 0,115 (7.2)

8 РАСЧЕТ ПРОИЗВОДИТЕЛЬНОСТИ ИСТОЧНИКА

И ПРОПУСКНОЙ СПОСОБНОСТИ КАНАЛА СВЯЗИ

Производительность источника сообщения находиться из равенства:

I`(x) = 2f0 ∙H(x) = 2 1600 11, 5 = 36800 бит/(симв·с) (8.1)

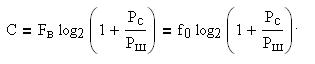

Пропускная способность канала связи определяется формулой Шеннона, которая означает условия согласования канала связи с источником сообщения

C = I`(x) = 36800 бит/с (8.2)

Сравнивая пропускную способность (8.2) с производительностью источника (8.1), можно найти значение отношения мощности сигнала и помехи, требуемое для согласования источника сообщения с каналом связи:

(8.3)

(8.3)

![]() (8.4)

(8.4)

Следовательно:

![]() (8.5)

(8.5)