Курсовая работа: Анализ методов определения минимального, максимального значения функции при наличии ограничений

f(x) = Q, g(x) £ Q.

(напомним, что неравенство g(x) £ Q означает покоординатные неравенства).

f0 (x) ® min, f(x) = Q, g(x) £ Q.

Через J(x) будет обозначаться множество индексов так называемых активных ограничений : J(x) = {j Î {1, ..., l}: gj (x) = 0} — это номера ограничений, которые в данной точке существенны.

Теорема (обобщенное правило множителей Лагранжа)

Пусть f0 , f, g Î C1 , а x* — локальное решение задачи f0 (x) ® min, f(x) = Q, g(x) £Q. Тогда найдутся такиеl*0 Î R, l* Î Rk , m* Î Rl , не равные одновременно нулю, такие, что m*j ³ 0 при j Î J(x*) и

l*0 f¢0 (x*)+![]() l*i f¢i (x*)+

l*i f¢i (x*)+ m*j g¢j (x*) = Q. (3.7)

m*j g¢j (x*) = Q. (3.7)

Регулярный случай

Так же, как и в случае ограничений-равенств, в случае общей задачи нелинейной оптимизации, необходимый признак, информативен только в случае, если l*0 ¹ 0. В этой ситуации можно разделить (3.7) на l*0 и, следовательно, считать его равным единице. Это позволяет ввести функцию Лагранжа L: Rm ×Rk ×Rk ® R (в регулярном случае) равенством

(x, l, m) = f0 (x) + (l, f(x)) + (m, g(x)).

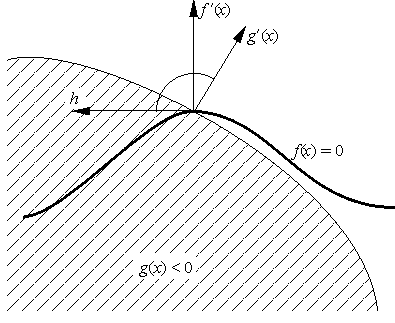

Условие регулярности в случае общей задачи выглядит сложнее. Именно, допустимая точка x называется регулярной , если векторы f ¢1 (x),..., f ¢k (x) линейно независимы и для некоторого ненулевого вектора

hÎRm (f¢i (x),h) = 0 при i = 1, ..., kи (g¢j (x),h) < 0 при jÎJ(x).

Геометрически, эти условия означают, что, во-первых, вектор h является касательным к многообразию, выделяемому ограничениями-равенствами (т. е. ортогонален всем градиентам f ¢i (x)), и, во-вторых, он образует с градиентами g¢j (x) активных ограничений (указывающими, очевидно, вовне множества W) тупой угол.

Рис. 3.3.

Методы возможных направлений

Эти методы основываются на следующем простом понятии. Вектор (направление) z в допустимой точке x назовем возможным для задачи (3.1), (3.3), если малое перемещение в этом направлении уменьшает значение функции f0 и не выводит из множества допустимых точек, т. е. если при достаточно малых s точка xs = x + sz допустима и f(xs ) < f(x). Если теперь на каждом шаге сдвигаться в возможном направлении на достаточно малое расстояние, то мы очевидно получим релаксационную последовательность, которая во многих случаях будет сходиться к решению задачи. Методы этого типа называются методами возможных направлений .

Методы проекции градиента

Проекцией PW x точки x Î Rm на множествоW Ì Rm называется любая ближайшая к x точка множества W:

||x PW x|| £ ||x y|| при всех y Î W.

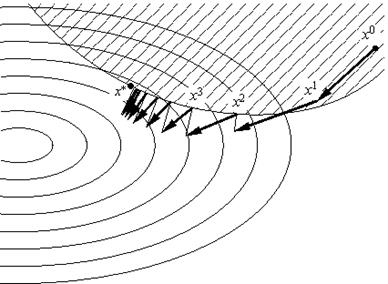

В тех случаях, когда проекцию точки на множество допустимых точек задачи (3.1), (3.3) найти достаточно легко (например, когда — линейное подпространство, полупространство, шар, Rm и т. д.) используют метод проекции градиента :

xn +1 = PW (xn an f¢0 (xn ))

(см. рис. 3.4), являющийся прямым обобщением градиентного метода.

Рис. 3.4.

Можно доказать, например, что если функция f0 Î C1 сильно выпукла и f ¢ удовлетворяет условию Липшица, а множество W замкнуто и ограничено, то метод проекции градиента сходится со скоростью геометрической прогрессии.

Методы линеаризации

Суть этих методов, как следует из названия, состоит в линеаризации минимизируемой функции и ограничений в очередной точке xn строящейся релаксационной последовательности и объявлении следующим значением xn +1 решения получающейся линейной задачи, т. е. задачи

(f ¢0 (xn ),x xn ) ® min, (3.8)

gi (xn ) + (g¢i (xn ),x xn ) £ 0, i = 1, ..., l. (3.9)

Чтобы эта (линейная) задача была разрешима либо добавляют штраф в минимизируемую функцию, заменяя (3.8), например, задачей